Prezentacja odbyła się podczas targów Computex 2024, a szczegóły wieloletnich planów przedstawiła dr Lisa Su, dyrektor generalna i przewodnicząca zarządu AMD.

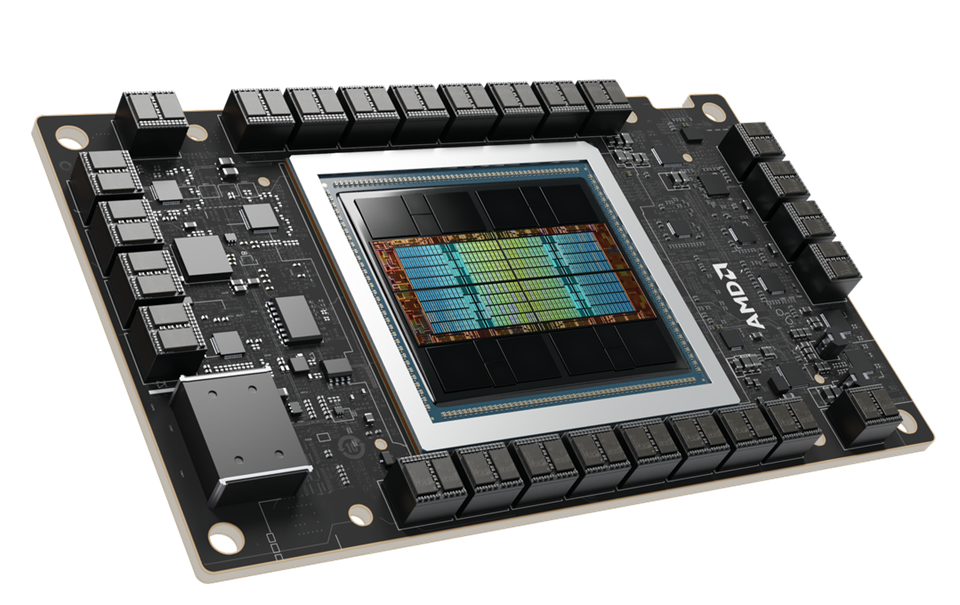

Jeszcze w IV kwartale 2024 roku wprowadzony zostanie nowy akcelerator AMD Instinct MI325X, który zaoferuje 288 GB pamięci HBM3E o przepustowości 6 TB/s. Jak poinformowano, dzięki temu zagwarantować on ma 2-krotnie więcej pamięci o 1,3-krotnie większej przepustowości niż konkurencja, a także 1,3-krotnie lepszą wydajność obliczeniową.

W drugiej połowie 2024 roku swoją premiera będzie miała natomiast 5 generacja procesorów AMD EPYC o kodowej nazwie „Turin”. Będą one wyposażone w 192 nowe rdzenie „Zen 5”, dzięki którym mają w dalszym ciągu zapewniać wysoką wydajność i efektywność.

Z kolei w 2025 roku firma wprowadzi na rynek pierwszy produkt skonstruowany w oparciu o następnej generacji architekturę AMD CDNA 4, czyli akcelerator AMD Instinct MI350X. Zostanie on wyprodukowany przy użyciu 3-nanometrowej technologii i będzie obsługiwał zarówno dane FP4 jak i FP6. Będzie także wyposażony w 288 GB pamięci HBM3E.

W roku 2026 producent chipów planuje natomiast wprowadzić akceleratory AMD Instinct z serii MI400, które będą bazowały na architekturze AMD CDNA „Next” – dzięki niej pojawić się mają nowe możliwości w zakresie wnioskowania i trenowania AI przy jednoczesnej znacznej poprawie efektywności energetycznej, zapewniają przedstawiciele koncernu.

Jak podkreślała dr Lisa Su, popyt na akceleratory AMD Instinct MI300X stale rośnie, a wielu partnerów i klientów używa ich do zasilania wymagających obciążeń związanych ze sztuczną inteligencją. I tak, przykładowo, Microsoft Azure wykorzystuje je dla usług Azure OpenAI oraz nowych maszyn wirtualnych Azure ND MI300X V5, firma HPE do akceleracji obciążeń AI w HPE Cray XD675, a Dell Technologies w PowerEdge XE9680 dla obciążeń AI w przedsiębiorstwach.