Sztuczna inteligencjaRynek

Snowflake uruchamia Arctic – otwarty model językowy klasy korporacyjnej

Nowy LLM od Snowflake wykorzystuje architekturę Mixture-of-Experts (MoE), która ma oferować wysokiej klasy inteligencję i wydajność na dużą skalę. Jak zapewniają przedstawiciele koncernu, zoptymalizowany pod kątem złożonych obciążeń korporacyjnych Arctic, osiąga bardzo dobre wyniki w zakresie generowania kodu SQL czy realizowania instrukcji.

Wraz z uruchomieniem Arctic, Snowflake dostarcza otwarty model na licencji Apache 2.0, która zezwala na nieograniczone użytkowanie osobiste, badawcze oraz komercyjne. Firma zapewnia również szablony kodu, a także elastyczne opcje wnioskowania i szkolenia, dzięki czemu użytkownicy mogą szybko rozpocząć wdrażanie i dostosowywanie Arctic przy użyciu preferowanych przez siebie frameworków. Obejmują one NVIDIA NIM z NVIDIA TensorRT-LLM, vLLM i Hugging Face.

Arctic jest też dostępny do bezserwerowego wnioskowania w Snowflake Cortex, w pełni zarządzanej usłudze Snowflake, która oferuje rozwiązania uczenia maszynowego i sztucznej inteligencji w chmurze danych.

Nowe rozwiązanie będzie również dostępne w ramach Amazon Web Services (AWS), wraz z innymi rodzinami modeli i katalogami, które będą obejmować Hugging Face, Lamini, Microsoft Azure, katalog API NVIDIA, Perplexity, Together AI i inne.

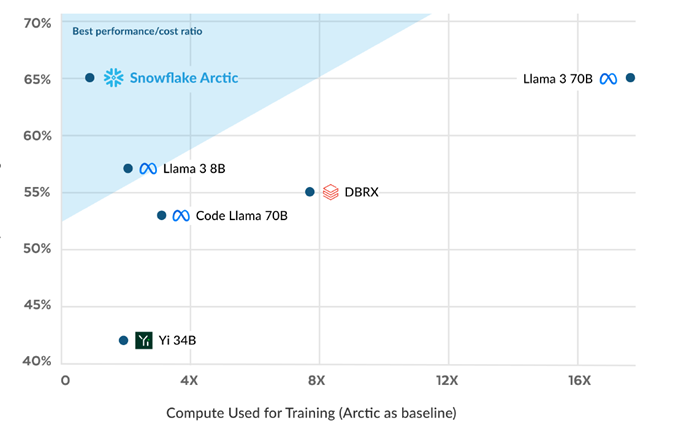

Jak zapewniają przedstawiciele Snowflake, Arctic aktywuje 17 z 480 miliardów parametrów jednocześnie, osiągając wiodącą w branży jakość. Oznacza to, że nowy model aktywuje około 50% mniej parametrów niż DBRX i 75% mniej niż Llama 3 70B podczas wnioskowania lub szkolenia. Ponadto, przewyższa on inne otwarte modele, w tym DBRX czy Mixtral-8x7B w kodowaniu (HumanEval+, MBPP+) i generowaniu SQL (Spider i Bird-SQL), zapewniając jednocześnie wysoką wydajność w ogólnym rozumieniu języka (MMLU).

Arctic został wyszkolony przy użyciu instancji Amazon Elastic Compute Cloud (Amazon EC2) P5. Stworzenie nowego modelu zajęło zespołowi badawczemu Snowflake ds. AI mniej niż trzy miesiące.

Oprócz Arctic LLM rodzina modeli Snowflake Arctic obejmuje również ogłoszoną niedawno Arctic embed, rodzinę najnowocześniejszych modeli osadzania tekstu dostępnych także dla społeczności open source na licencji Apache 2.0. Rodzina pięciu modeli jest już dostępna w ramach Hugging Face, a wkrótce będzie dostępna jako część funkcji osadzania w Snowflake Cortex (private preview).