AplikacjeRynekPolecane tematy

Dlaczego ChatGPT nas okłamuje?

Popularność ChatGPT wygląda imponująco – w styczniu tego roku miał on 100 mln aktywnych użytkowników, a w kwietniu już ponad 170 milionów. Z kolei w maju br. łączna liczba odwiedzin przekroczyła dwa miliardy. Gdy już raz z niego skorzystamy, z reguły chcemy więcej i więcej. Jak wynika z badania firmy Symetria, blisko 70% osób korzysta z tej aplikacji od kilku razy dziennie do kilku razy w tygodniu. Co ciekawe, nawet osoby zawodowo zajmujące się technologiami nie do końca rozumieją jednak zasady działania ChatGPT – i choć 77% respondentów trafiło na nieprawdziwe informacje, zaledwie nieco ponad 40% pyta to narzędzie o źródła. Jak się okazuje, nawet wtedy ChatGPT potrafi nas okłamać. Dlaczego to robi?

Na potrzeby raportu „Symetria między człowiekiem a technologią”, w kwietniu br. specjaliści z firmy Symetria przeprowadzili badanie wśród grupy 108 innowatorów, mające na celu sprawdzenie jak użytkownicy radzą sobie z ChatGPT. W ankiecie wzięli udział m.in. informatycy, ale też pracownicy mediów czy ludzie związani zawodowo z edukacją oraz światem finansów. Większość z badanych miała już ponad miesięczne doświadczenie z korzystania z narzędzia stworzonego przez OpenAI, a wspomniane ponad 70% sprawdzało rozwiązania ChatGPT kilka razy dziennie.

Co ciekawe blisko 90% badanych mimo wykrycia wad i niedoskonałości tego narzędzia decydowało się korzystać z tej formy wyszukiwania informacji coraz częściej. Oznacza to, że sposób prezentowania treści jest dla odbiorcy ciekawy, a samo korzystanie z promptów (więcej na ich temat pisaliśmy w ITwiz tu) staje się intuicyjne.

„W momencie przeprowadzania ankiety od pojawienia się ChatGPT minęło pół roku. Mogłoby się jednak wydawać, że minęło przynajmniej kilka lat. Zmiany w zachowaniu konsumentów są już tak znaczące, że wiele osób, szczególnie „grupa innowatorów”, nie wyobraża sobie powrotu do poprzedniej ery. Mamy do dyspozycji potężne narzędzie, do którego bardzo szybko i łatwo się przyzwyczaić. ChatGPT pomaga nam lepiej pisać, tłumaczy trudne zagadnienia, daje podpowiedzi do życia biznesowego, ale też prywatnego. Najbardziej imponujący jest fakt, że aż 41% z użytkowników ChatGPT wpisuje bezpośrednio link do strony w pasku przeglądarki. Prawie każda firma mogłaby o tym marzyć” – komentuje Piotr Bombol, założyciel Adaily, platformy dla marketerów i jeden z ankietowanych przez Symetrię.

Lubimy korzystać, ale czy weryfikujemy?

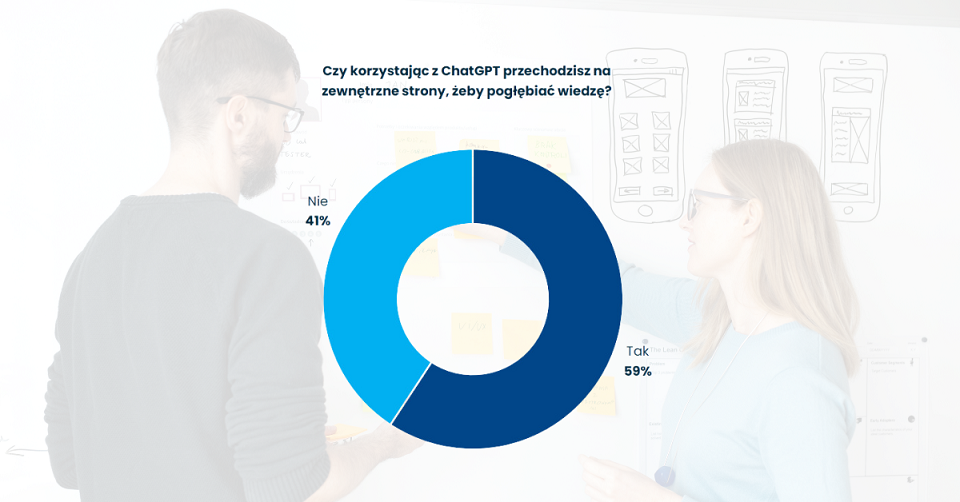

Naturalny język i konwersacyjny styl udzielanych przez ChatGPT wypowiedzi spowodował, że każdy badany choć raz dopytywał narzędzie o bardziej szczegółowe wypowiedzi. Często lub zawsze robiło tak ponad 60% ankietowanych. Dla podobnej wielkościowo grupy informacje pozyskane za pomocą ChatGPT nie są jednak wystarczające. Osoby te przechodzą jeszcze na zewnętrzne źródła informacji, aby pogłębić pozyskaną w tym narzędziu wiedzę.

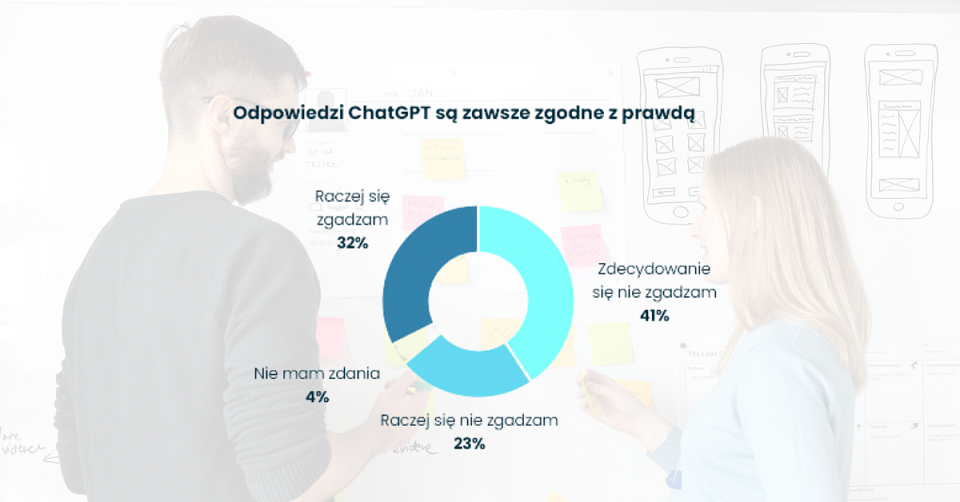

Jak już wspomniano, nawet 77% osób uczestniczących w badaniu trafiło na nieprawdziwe informacje w wynikach wyszukiwania. Mimo tego nie wszyscy z nich wyrobili w sobie nawyk krytycznego podejścia do przedstawianych wiadomości. Większość użytkowników nie sprawdza bowiem źródeł uzyskanych odpowiedzi. O te zapytało zaledwie 41% respondentów, przy czym zdecydowana większość z nich wskazała, że natrafiła na problemy chcąc odnaleźć wskazane przez ChatGPT odnośniki do stron, z których rzekomo pochodzą informacje do przygotowanych zapytań.

Warto bowiem pamiętać, że ChatGPT nie jest wyszukiwarką internetową tylko modelem językowym, którego zadaniem jest kontynuowanie tekstu, tak aby generować adekwatną do „promptu” treść. Brzmiącą tak, jakby napisał ją człowiek. Proces generowania przez ChatGPT odpowiedzi na postawione przez użytkownika pytanie różni się zatem od wyszukiwarki, nie tylko na poziomie interakcji, ale również kształtem i jakością otrzymanego rezultatu.

„Wynikami nie są już treści stron www, których rzetelność można ocenić m.in. na podstawie autorytetu autorów lub portali, jakości powiązanych źródeł czy daty publikacji treści. Odpowiedzią ChatGPT jest tekst, wygenerowany na podstawie modelu językowego wytrenowany na olbrzymim zbiorze danych treningowych, które jednak nie pokrywają wszystkich możliwych tematów i koncepcji. Dodatkowo zbiór ten mógł zawierać błędy, co może przekładać się czasami na stronniczość odpowiedzi lub zawarte w nich pomyłki. Choć wiele odpowiedzi ChatGPT jest zaskakująco dobrych i może zachwycać swoją błyskotliwością, ciężko jest im w pełni zawierzyć. Prostota użycia narzędzia i szybkość otrzymania odpowiedzi nie gwarantują jej jakości i poprawności” – zaznacza Paweł Nowak, projektant UX oraz założyciel NOWY i WUD Silesia, kolejny ankietowany w badaniu Syme

Czy sztuczna inteligencja wstydzi się powiedzieć „nie wiem”?

Dlaczego ChatGPT kłamie? Bo użytkownik oczekuje odpowiedzi i nie przyjmie słów „nie wiem”. A sztuczna inteligencja dobrze to wie. Dlatego wprowadza w błąd, nawet w tak przekonujący sposób, że jest w stanie wyświetlić linki źródłowe, które jednak prowadzą w internetową pustkę – do nieistniejących stron. Nazywa się to halucynacją – udzielaniem odpowiedzi, mimo że nie zna się właściwego rozwiązania, więc wyświetla „najbardziej prawdopodobną wersję”.

„ChatGPT to najszybciej rosnąca aplikacja na świecie, która na niespotykaną dotąd skalę zyskuje coraz szersze grono użytkowników. Aż 73% osób uznało, że ChatGPT lepiej rozumie intencje zadawanego pytania niż tradycyjna wyszukiwarka. W rozpoczynającym się właśnie wyścigu, na wdrażanie narzędzi konwersacyjnych opartych na AI, warto zrozumieć i uwzględnić potrzeby użytkowników. Dzięki temu ten nowy sposób komunikacji człowiek-komputer ma szansę stać się pozytywnym i zapamiętywanym doświadczeniem” – komentuje Monika Banach, Innovation Expert w Symetrii.

Autorzy raportu podkreślają, że warto już dziś lepiej poznawać możliwości AI, bo technologia ta zostanie z nami na długo. „Nasze badanie pokazało, że nawet osoby pracujące na co dzień z technologią nie rozumieją w pełni czym jest ChatGPT. Im mniejsze zrozumienie, tym większa podatność na manipulację i częściej popełniania się też błędy, których można uniknąć przy większej kontroli nad odpowiedziami. Może to skutecznie zniechęcić klientów do tej obiecującej technologii, a firmy narazić na ryzyko strat finansowych lub wizerunkowych” – podsumowuje Krzysztof Kozak z Symetrii.

Pełny raport Symetrii można pobrać tutaj.